Leseprobe

Inhaltsverzeichnis

Abkürzungsverzeichnis

Abbildungsverzeichnis

1 Einleitung

2 Biologische Grundlagen

2.1 Die Nervenzelle

2.2 Die Bestandteile eines Neurons

2.3 Künstliche Intelligenz

2.4 Die Geschichte künstlicher Intelligenz

3 Neuronale Netze

3.1 Begriffliche Abgrenzung

3.2 Neuronale Modelle

3.3 Das Neuron

3.4 Die Funktionsweise neuronaler Netze

3.5 Der Lernalgorithmus

3.6 Die Vernetzungsstruktur

3.7 Die Berechnungsreihenfolge

3.8 Die Optimierungsprobleme

3.9 Die Propagierungsfunktion

3.10 Die Aktivierungsfunktion

3.11 Die Ausgabefunktion

3.12 Der Netzwerkgraph

3.13 Die Lernregeln

3.14 Das Perzeptron

3.15 Die Netztypen

3.16 Anwendungsbeispiele neuronaler Netze

4 Usability

4.1 Definition Usability

4.2 Usability-Probleme

4.3 Usability-Engineering

4.4 Methoden der Usability-Evaluation

5 Durchführung von Probanden-Tests mithilfe der Software MemBrain

5.1 Was ist MemBrain?

5.2 Grundlagen

5.3 Funktionsweise von MemBrain

5.4 Beschreibung der Probanden-Tests

6 Zusammenfassung

6.1 Eigenschaften

6.2 Grundlagen

6.3 Lernregeln

6.4 Netztypen

6.5 Anwendungen

6.6 Verifizierung der Masterthesis

Literaturverzeichnis

Anhang

Fragebogen

Beobachtungsprotokoll

Abkürzungsverzeichnis

Abbildung in dieser Leseprobe nicht enthalten

Abbildungsverzeichnis

Abb. 1: Schematischer Aufbau eines Neurons (Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen.)

Abb. 2: Möglichkeiten der Verschaltung von Neuronen (Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen.)

Abb. 3: Der Aufbau einer Nervenzelle (Vgl. Ziegler, Wolfgang (2015): Neuronale Netze.)

Abb. 4: Vorwärtsgerichtete und rückgekoppelte Topologien (Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution.)

Abb. 5: Winner-takes-all-Netze mit lateraler Inhibition in der Wettbewerbsschicht (Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution.)

Abb. 6: Aufbau eines biologischen Neurons (schematisch) (Vgl. Füser, Karten (2013): Neuronale Netze in der Finanzwirtschaft. Innovative Konzepte und Einsatzmöglichkeiten.)

Abb. 7: Modelle Vernetzungsstrukturen (Vgl. Braun, Heinrich / Feulner, Johannes / Malaka, Rainer (1996): Praktikum Neuronale Netze. 1996.)

Abb. 8: Übersichtstabelle der Lernregeln (Vgl. In: Neuronale Netze. Eine Einführung. Druckversion der Internetseite www.neuronalesnetz.de. Stand: 01.08.2017.)

Abb. 9: Schematische Darstellung eines Perzeptrons (Vgl. Nauck, Detlef D. / Klawonn, Frank / Kruse, Rudolf (1994): Neuronale Netze und Fuzzy-Systeme: Grundlagen des Konnektionismus, Neuronaler Fuzzy-Systeme und der Kopplung mit wissensbasierten Methoden. )

Abb. 10: Diverse Arten von Rückkopplungen (In: Willig, Hans-Peter (2010): http://www.biologie-seite.de/Biologie/Rekurrentes_neuronales_Netz. (Stand: 01.08.2017)

Abb. 11: Beispiel des Aufbaus eines Jordan-Netzes (In: Cleve, Jürgen / Lämmel, Uwe (2012): Künstliche Intelligenz.)

Abb. 12: Die Grundstruktur eines kompetitiven Netzwerkes (In: Rösler, Frank (2011): Psychophysiologie der Kognition: Eine Einführung in die Kognitive Neurowissenschaft.)

Abb. 13: Schematische Darstellung eines 2-dimensionalen Kohonen-Netzes (In: Neuronale Netze. Eine Einführung. Druckversion der Internetseite www.neuronalesnetz.de. Seite34. Stand: 01.08.2017)

Abb. 14: Übersichtstabelle aller Netztypen (In: Neuronale Netze. Eine Einführung. Druckversion der Internetseite www.neuronalesnetz.de. Seite 38. Stand: 01.08.2017)

Abb. 15: Fotos von Erdbeeren unter verschiedenen Beleuchtungsumgebungen (In: Neuronale Netze. Eine Einführung. Druckversion der Internetseite www.neuronalesnetz.de. Seite 46. (Stand: 07.08.2017).

Abb. 16: Die Gruppierung der Evaluationsmethoden (In: Daab, Theresa (2012): Methoden der Usability Evaluation: Wissenschaftliche Grundlagen und praktische Anwendung anhand von Fallbeispielen.)

Abb. 17: Der Ablauf der heuristischen Evaluation (In: Daab, Theresa (2012): Methoden der Usability Evaluation: Wissenschaftliche Grundlagen und praktische Anwendung anhand von Fallbeispielen.)

Abb. 18: Der Ablauf des Cognitive Walkthrough (In: Daab, Theresa (2012): Methoden der Usability Evaluation: Wissenschaftliche Grundlagen und praktische Anwendung anhand von Fallbeispielen.)

Abb. 19: Darstellung der wichtigsten Aspekte eines Fragebogens (Jotz, Melanie (2016): Fragebögen als Ergänzung des Usability Tests, In: Forschungsbeiträge der eResult GmbH. In: http://www.eresult.de/ux-wissen/forschungsbeitraege/einzelansicht/news/frageboegen-als-ergaenzung-des-usability-tests/ (Stand: 04.08.2017))

Abb. 20: Erstellung einer Unit mittels MemBrain (eigene Darstellung)

Abb. 21: Drei Units in MemBrain (eigene Darstellung)

Abb. 22: Drei miteinander verbundene Units in MemBrain (eigene Darstellung)

Abb. 23: Wahrheitstabelle für das Oder-Gatter (eigene Darstellung)

Abb. 24: Fehlerkurve des neuronalen Netzes für die ersten ca. 100 Durchläufe (Vgl. In: Neuronale Netze. Eine Einführung. Druckversion der Internetseite www.neuronalesnetz.de. Seite 67. (Stand: 01.08.2017).

1 Einleitung

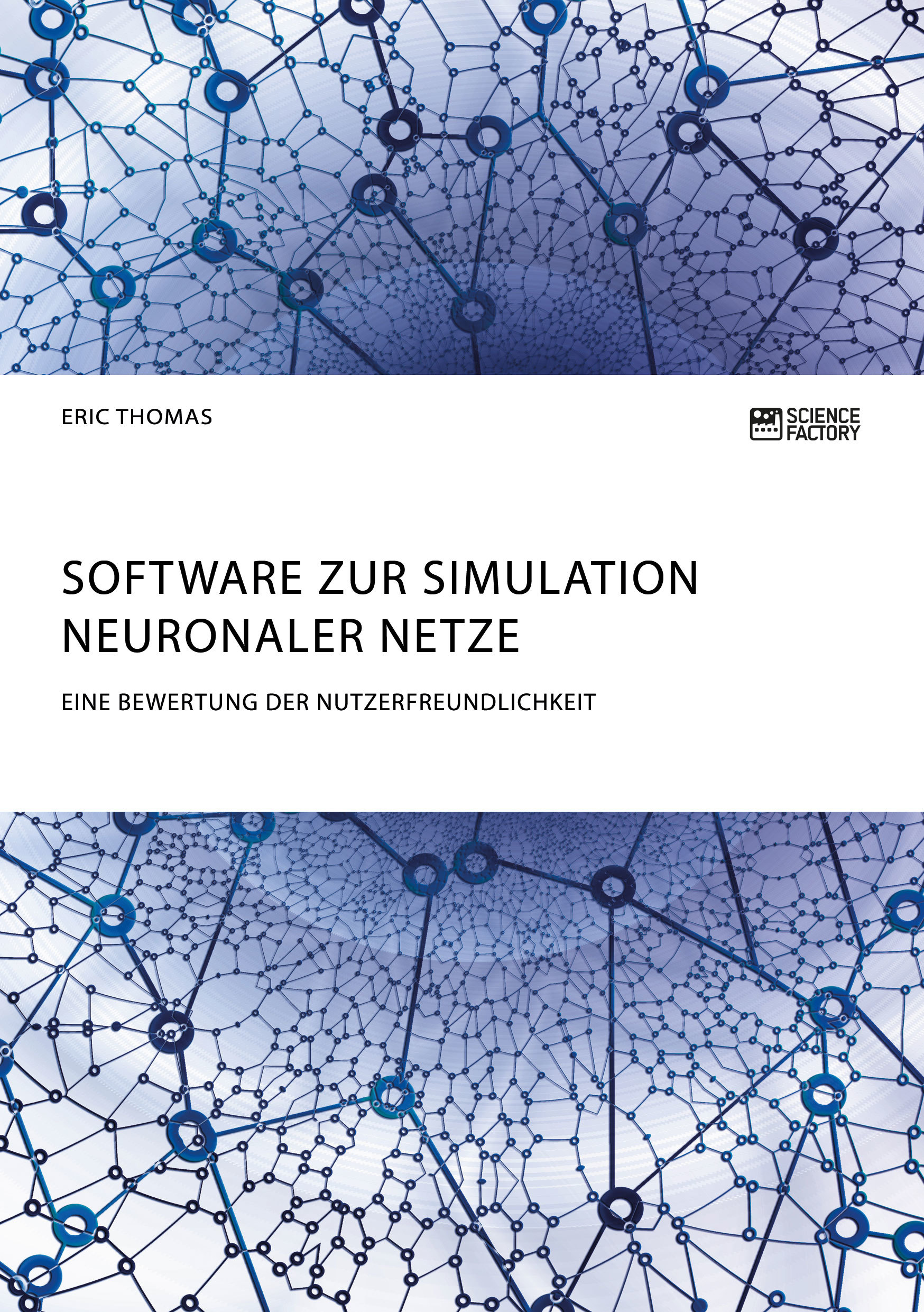

Im Rahmen des Studiengangs Informationsdesign und Medienmanagement im Fachbereich Wirtschaftswissenschaften und Informationswissenschaften an der Hochschule Merseburg ist eine Masterthesis in entsprechenden Umfang zu analysieren, um einen erfolgreichen Abschluss zu erlangen. Als Thema dieser Arbeit wurde die „Dokumentation und Usability-Evaluation von Softwarelösungen zur Simulation neuronaler Netze“ gewählt. Das grundlegende Ziel innerhalb der Untersuchung war es, mithilfe einer geeigneten Software auf einfachstem Wege sogenannte neuronale Netze zu erstellen. Zur Umsetzung dieses Vorhabens wurde sich auf das Programm „Mem-Brain“ fokussiert. Diese Software ist kostenlos und auf jedem beliebigen Rechner installierbar.

Nach einer Einleitung in die Thematik werden zunächst einmal die biologischen Grundlagen der Problematik abgehandelt. Im Rahmen dessen findet zuerst eine begriffliche Abgrenzung statt. Darauffolgend schließen sich die Vorstellung einer Nervenzelle sowie die Beschreibung der Bestandteile eines Neurons an. Außerdem wird ein grundlegender und geschichtlicher Einblick in das Themengebiet der künstlichen Intelligenz gegeben.

Als erster Hauptpunkt der Arbeit wird das Themengebiet der neuronalen Netze vorgestellt und erläutert. Hierbei werden die einzelnen verschiedenen Arten neuronaler Netze sowie die Lernregeln, welche in Bezug auf diese Netze angewandt werden, vorgestellt. Im Zusammenhang damit rückt auch das sogenannte Perzeptron in den Fokus. Um die Problematik abzurunden, werden zwei Anwendungsbeispiele derartiger Netzwerke im Grundlegenden präsentiert und erörtert.

Darauffolgend schließt sich der zweite theoretische Bestandteil der Thesis an, nämlich die Nutzbarkeit (Usability). Hierbei werden nach einer Definition und einer Einordnung der Begrifflichkeit die einzelnen Methoden für Usability-Evaluationen dargeboten. Der Fokus liegt diesbezüglich auf den Fragebögen, da sie das Medium der Usability-Tests darstellen, welche in dieser Arbeit vorgestellt und beschrieben werden.

Im Anschluss daran folgt der praktische Teil der Abhandlung. Innerhalb der Ausarbeitung wurden insgesamt sieben Probanden-Tests durchgeführt. Die Testpersonen, zum Teil wenig Vorwissen im Bereich neuronale Netze und Elektrotechnik besitzend, sollten mithilfe der Software „MemBrain“ auf möglichst einfache Weise derartige Netze erstellen und die bestehenden Lernregeln anwenden. Innerhalb dieses Unterpunkts der Masterarbeit wird zunächst erklärt, wobei es sich bei MemBrain handelt. Außerdem werden die einzelnen elementaren Funktionen vorgestellt.

Im Anschluss an den praktischen Teil folgt abschließend noch die Zusammenfassung der Thematik neuronaler Netze. Außerdem erfolgt die Verifizierung der Masterthesis.

2 Biologische Grundlagen

In diesem Themenpunkt sollen die Grundlagen neuronaler Netze auf biologischer Ebene beleuchtet werden. Unter diesem Gesichtspunkt sind lediglich die Prinzipien, welche im Zusammenhang mit der Verarbeitung von Informationen existieren, vorzustellen. Im Zuge dieses Kapitels werden die Hauptmerkmale neuronaler Netze beschrieben. Des Weiteren wird der Bezug zu gleichartigen mathematischen Modellen hergestellt. Danach schließt sich die Beschreibung des Aufbaus einer Nervenzelle und deren Funktionalität an. Infolgedessen wird die Weiterleitung von Informationen innerhalb der neuronalen Netze erläutert. Zuletzt werden die Prinzipien der Organisation von vielschichtigen Neuronen-Systemen erklärt.[1]

Der eigentliche Ursprung von neuronalen Netzen liegt im Bereich der Biologie. Diese Netze besitzen grundsätzlich eine Ähnlichkeit zum Gehirn von Säugetieren. Die Funktion derartiger künstlicher neuronaler Netze liegt in der Informationsverarbeitung. Sie setzen sich aus einer hohen Anzahl von Neuronen zusammen. Dies sind einfache Einheiten, welche sich mithilfe einer Aktivierung der Neuronen über gerichtete, gewichtete Verbindungen Informationen zusenden. Neuronale Netze stellen massiv parallele, lernfähige Systeme dar, die Aufgaben eigenständig unter Verwendung von Trainingsbeispielen erlernen können.[2]

2.1 Die Nervenzelle

Abbildung in dieser Leseprobe nicht enthalten

Abb. 1: Schematischer Aufbau eines Neurons (Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen. Seite 33.)

Als grundlegende Bestandteile eines Nervensystems sind die Nervenzellen (Ganglienzellen, Neurone) zu nennen. Um einen genauen Wert in Bezug auf die Anzahl der Neuronen innerhalb des menschlichen Nervensystems festzulegen, lässt sich der Wert 2,5 x 210 wählen. Im Großen und Ganzen lässt sich feststellen, dass der Aufbau einer Nervenzelle mit dem Aufbau anderer Zelltypen vergleichbar ist. Der elementare Bestandteil hierbei ist die Zellmembran. Diese umgibt die Zellflüssigkeit (Cytoplasma) und den Zellkern. Die Zusammensetzung einer Nervenzelle ist in der nachfolgenden Grafik dargestellt:[3]

Abbildung in dieser Leseprobe nicht enthalten

Abb. 2: Möglichkeiten der Verschaltung von Neuronen (Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen. Seite 34.)

Dem menschlichen Gehirn ist ein erfahrungsbasierendes Lernen, ohne den Gebrauch von direkten Anweisungen, möglich. Seit Existenz der Informatik in Form einer wissenschaftlichen Disziplin wird innerhalb dieses Bereichs stets das Ziel verfolgt, eine Nachahmung und Simulation des Prozesses, mithilfe von elektronischen Ressourcen, zu erreichen. An dieser Stelle wird den neuronalen Netzen eine besondere Wichtigkeit zugeschrieben, denn diese können mit einem menschlichen Gehirn verglichen werden, dessen Neuronen rein schematisch vergleichbar sind.

Zur Abgrenzung der Thematik soll zunächst in künstliche und natürliche neuronale Netze unterschieden werden. Um eine grundlegende Einführung zu leisten, ist eine Abhandlung der biologischen Grundsätze und der Funktionsweise natürlicher Neuronen vonnöten. Das Prinzip, was hinter der Funktionsweise von Nervenstellen erkennbar wird, lässt sich ziemlich passend auf ein Softwaremodell übertragen.

Im Allgemein lässt sich ein natürliches Neuron in folgende Bestandteile aufteilen:

- Zellkörper

- Dendriten (gr. Dendrom, Baum)

- Axon (gr. Axon, Achse)

Abbildung in dieser Leseprobe nicht enthalten

Abb. 3: Der Aufbau einer Nervenzelle (Vgl. Ziegler, Wolfgang (2015): Neuronale Netze. Seite 1.)

Die Dendriten eines Neurons und das Axon eines folgenden Neurons bilden den synaptischen Spalt und stellen die Verbindung zwischen den Nervenzellen dar. Außerdem werden dadurch der Austausch von Informationen sowie der grundlegende Lernprozess des Gehirns realisierbar. Eines der Neuronen kann in diesen Fall mit dessen Dendriten ankommende Signale aufnehmen. Diese Signale werden dann über das Axon innerhalb des Neurons weitergeleitet, was über elektrische Impulse erfolgt. Die aufsummierten elektrischen Impulse werden am Axon danach in ein chemisches Signal umgewandelt. Dies erfolgt durch die Ausschüttung bestimmter Botenstoffe, genannt Neurotransmitter. Kommt es zur Überschreitung des Schwellenwerts der ausgeschütteten Botenstoffe, tritt eine elektrische Stimulation und Impulsbildung an den Dendriten der nachfolgenden Nervenzelle ein. Daraus resultierend wird entschieden, ob eine Weitergabe des jeweiligen Signals stattfindet oder nicht. Infolgedessen konnte eine Abhängigkeit in Bezug auf den Informationsaustausch zwischen Neuronen von diesen synaptischen Faktoren der Übertragung festgestellt werden. Dazu zählen auch die Lernvorgänge.[4]

2.2 Die Bestandteile eines Neurons

Wenn der Aufbau eines Neurons innerhalb der funktionellen Ebene erklärt werden soll, lassen sich vier Komponenten nennen:

- Soma (Stellt den Zellkörper eines Neurons dar.)

- Axon (Ein Axon verbindet die einzelnen Neuronen im zentralen Nervensystem miteinander.)

- Dendriten (Ermöglichen die Aufnahme von Reizen.)

- Synapse (Eine Synapse dient zur Verbindung eines Axons mit einer anderen Zelle.)[5]

2.3 Künstliche Intelligenz

Das Themengebiet der künstlichen Intelligenz weist ein außerordentlich hohes Interesse auf. Der Hauptgrund dafür ist, dass der Mensch mithilfe genau dieser, ihm eigenen Intelligenz, ein besonderes Alleinstellungsmerkmal unter allen Lebewesen aufweist. Es soll geklärt werden, was sich unter Intelligenz überhaupt verbirgt oder wie diese zu messen ist. Aber auch die Frage nach der Funktionsweise des menschlichen Gehirns vermag geklärt zu werden. Beispielsweise interessiert einen Informatiker die Konstruktion einer sogenannten intelligenten Maschine. Diese soll in der Lage sein, intelligentes Verhalten zu besitzen. Dadurch soll diese Maschine ein menschenähnliches Verhalten simulieren können.

Bei Betrachtung des Wortes „künstlich“ liegt der Fokus auf Robotern, die Intelligenz aufweisen. Damit sind menschliche Emotionen wie beispielsweise verschiedene Ängste verbunden. Im Zusammenhang hiermit ist zu überlegen, ob es überhaupt notwendig ist, etwas derart Komplexes wie das Gehirn, zu begreifen oder sogar nachzukonstruieren.

Dadurch, dass für die Begrifflichkeit „Künstliche Intelligenz“ auf diverse Art und Weise interpretierbar ist, kann nur sehr schwer von einer einheitlichen Definition gesprochen werden. Um nur eine mögliche Definition anzugeben, ist einer Wegbereiter der KI, John McCarthy zu nennen. Dieser definierte 1955 wie folgt:[6]

„Ziel der KI ist es, Maschinen zu entwickeln, die sich verhalten, als verfügten sie über Intelligenz.“[7]

2.4 Die Geschichte künstlicher Intelligenz

Der Wunsch nach künstlicher Intelligenz und somit der Erzeugung von neuronalen Netzen existiert seit mehr als eintausend Jahren. Die ersten Aufzeichnungen über die Erklärung der Funktionsweise des menschlichen Gehirns gehen bis circa 3000 v. Chr. zurück. Die ersten Dokumentationen der jüngeren Jahrhunderte stammen von W. James (1890) und A. Turing (1936), welche das menschliche Gehirn als Exempel für einen Computer betitelten. Dennoch sind als erste wirkliche Wegbereiter W.S. McCulloch und W. Pitts zu nennen. Diese beiden Wissenschaftler entwickelten im Jahre 1943 das mathematische Modell eines Neurons. Hierbei wurde, stark simplifiziert, mithilfe einer Zelle erklärt, dass innerhalb eines Gehirns dieselbe Logik vonstattengeht, wie auch bei einem Computer. Sechs Jahre später, 1949, wurde bekannt, dass den Zellen die Fähigkeit des Lernens zugeschrieben werden kann. Eine Lernregel hierzu stammt von dem kognitiven Psychobiologen D.O. Hebb. Ein weiteres wichtiges Modell in der Geschichte von neuronalen Netzwerken ist das so bezeichnete Perzeptron. Dieses beschreibt die Möglichkeit ein adaptives klassifizierendes System zu entwickeln. Es stammt von F. Rosenblatt aus dem Jahre 1958. Trotz dieser erfolgsversprechenden Ergebnisse der Wissenschaftler, geriet die Thematik fast in Vergessenheit. Danach wurde bis ins Jahr 1985 nicht tiefgründig weitergeforscht. In diesem Jahr setzte sich dann der Error-Backpropagation-Algorithmus durch, worunter eine mathematische Technik von D. Rumelhart und G. Hinton zu verstehen ist. Diese sogenannte Backpropagation ermöglicht es, den komplizierten, verzwickten Netzen ein bestimmtes Verhalten zu beschaffen. Hieraus resultierend stieg das Interesse in diesem Gebiet wieder maßgeblich an.[8]

Die große Beliebtheit von neuronalen Netzen existiert, da mit deren Hilfe bestimmte Aufgabenstellungen erschlossen werden können, deren Bearbeitung mit sonstigen Methoden nicht möglich gewesen wären. Innerhalb der meisten Streitfragen, welche den Mensch betreffen, ist keine direkt algorithmische Formulierung möglich. Um solche Probleme zu lösen, steht in Form von neuronalen Netze eine gute Alternative zu Verfügung und bietet damit komplett neue Möglichkeiten. Zum einen ist dabei zu nennen, dass es nicht mehr notwendig ist, Systeme zu programmieren, da diese in der Lage sind, von allein zu lernen. Um dazu ergänzend die wichtigsten Merkmale von neuronalen Netze aufzählen, ist von Generalisierbarkeit, Fehlertoleranz und der unscharfen Informationsverarbeitung die Rede. Gegenwärtig ist ein sehr hoher Wissensstandpunkt in Bezug auf die neuronalen Netze erreicht wurden. Tiefgründige Fortschritte konnten innerhalb von diversen Standardanwendungen in verschiedenen Bereichen innerhalb der letzten Jahre erzielt werden. Dies ist auch nicht zuletzt der sehr schnellen Entwicklung innerhalb der Computerindustrie geschuldet. Aktuell findet die Mehrheit der neuronalen Netze ihre Anwendung in sequentiellen Programmen, wodurch sie auf den Arbeitsoberflächen von Computer angewandt werden. Jedoch ist es den neuronalen Netzen nicht möglich, hierbei eine wichtige Funktion dabei anzuwenden, nämlich ihre Parallelität. Das heißt, es können nicht mehrere Berechnungsvorgänge gleichzeitig stattfinden, sondern nur nacheinander.[9]

3 Neuronale Netze

Der Ursprung innerhalb des Themengebietes der neuronalen Netze fand bereits im Jahr 1943 statt, als die Forscher W. McCulloch und W. Pitts das allererste Neuronen-Modell präsentierten. Innerhalb der fünfziger und sechziger Jahre gab es zahlreiche und tiefgründige Untersuchungen in diesem Bereich. Jedoch erfuhren sie in den sechziger Jahren einen wesentlichen Verlust an Interesse, da eine rasante Entwicklung im Bereich der Künstlichen Intelligenz (KI) Einzug nahm. Diese Entwicklung änderte sich allerdings erneut gegen Mitte der achtziger Jahre, da nun das Ziel verfolgt wurde, mithilfe neuronaler Netze bestimmte Problemstellungen innerhalb des Arbeitsbereichs der KI zu lösen. Im nächsten Unterpunkt der Arbeit sollen die besonderen Merkmale neuronaler Netze beschrieben werden.[10]

3.1 Begriffliche Abgrenzung

Aufgrund diverser inhaltlicher Gesichtspunkte und der ständigen Entwicklung des Forschungsgebietes, konnte noch keine einheitliche Begrifflichkeit für neuronale Netze gegeben werden. Es lassen sich einige weitere Bezeichnungen feststellen. Dazu zählen beispielsweise neurale Netze, künstliche neurale Netze oder konnektionistische Modelle. Zusätzlich zu der Feststellung von diversen Begriffen in der Forschung, ist innerhalb dieser Thematik auch von unterschiedlichen Zielen und Themenschwerpunkten die Rede.

In diesem Zusammenhang lässt sich von

- dem deskriptiven

- dem normativen und

- dem pragmatischen Ansatz

sprechen.

Bei Betrachtung des deskriptiven Ansatzes ist der Hauptaspekt in der Gleichheit neuronaler Netze im biologischen Zusammenhang festzustellen. Das Ziel der Modelle, eine reibungslose Funktionsweise zu erreichen, lässt erforderliche Änderungen an unbekannten Eigenschaften des biologischen Systems realisierbar machen.

Das Themengebiet der Betrachtung der mathematischen und statistischen Hintergründe ist durch den normativen Ansatz beschrieben. In diesem Zusammenhang werden vergleichbare Techniken analysiert.

Unter dem pragmatischen Ansatz wird die Sichtweise der Datenverarbeitung in Bezug auf neuronale Netze verstanden. Zu den Kernaufgaben in diesem Bereich zählen die Lernfähigkeit, Fehlertoleranz, Mustererkennungsfähigkeit. Mithilfe dieser Aspekte können intelligente Systeme erzeugt werden, welche eine korrekte und gute Aufgabenlösung ermöglichen.[11]

3.2 Neuronale Modelle

Unter den sogenannten neuronalen Netzmodellen sind im Allgemeinen Schaltkreise zu verstehen, welche Neuronen in Form von Gattern besitzen. Im biologischen Sinne besteht ein solches Neuron aus einer Anzahl von Eingängen und einem Ausgang, beziehungsweise, einer Ausgabe. Bezogen auf die Eingänge lässt sich ein Vergleich mit der Biologie ziehen. Hierbei sind die Synapsen gemeint. Diese fungieren als feste Kontaktpunkte eines Neurons, in Bezug auf den Dendritenbaum des Neurons. Im Gegensatz dazu bezeichnet man die Ausgabe biologisch als Axon.[12]

Prinzipiell ist zu sagen, dass es unendlich viele Eingänge in einem neuronalen Netz geben kann. Daraus resultierend ist es möglich, dass jedes Neuron eine Eingabe erhalten könnte. Dies wiederum bedeutet, dass es die Ausgabe eines jeden einzelnen, anderen Neurons empfangen kann.

Jedes Neuron verfügt über eine sogenannte Berechnungsfunktion. Diese besteht zum einen aus einer linearen Funktion und zum anderen aus einer nichtlinearen Funktion bezüglich der Ausgabe.[13]

„Der lineare Anteil ist die gewichtete Summe der Eingaben abzüglich einer Schwelle und wird beim Neuron durch die Gewichte (Verbindungsstärke der Synapse für die Eingabe vom Neuron an ein anderes Neuron) und die Schwelle, spezifiziert.“[14]

Zur Darstellung einer Ausgabefunktion dienen beschränkte Funktionen, welche sich im eindimensionalen Zustand befinden. Es existieren hierbei verschiedene Funktionstypen.

Der erste Typ heißt deterministisch. Hierzu zählen folgende Funktionen:

- Die Stufenfunktion

- Die Rampenfunktion

- Die sigmoide Funktion

- Die Gauß-glockenförmige Funktion

Der zweite Typ nennt sich stochastisch. Hierzu kann die sogenannte sigmoide Verteilungsfunktion erwähnt werden.[15]

Bezüglich des Aufbaus eines solchen neuronalen Netzwerkes ist zwischen vorwärtsgerichteten (azyklischen) und rückwärtsgerichteten (rückgekoppelten) Schaltkreisen zu differenzieren. Das sogenannte Multilayer Perceptron ist als Exempel für vorwärtsgerichtete Netze aufzuführen, während Hopfield-Netze und die Boltzmann-Maschine die rückgekoppelten Netze repräsentieren.

Abbildung in dieser Leseprobe nicht enthalten

Abb. 4: Vorwärtsgerichtete und rückgekoppelte Topologien (Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution. Seite 9.)

Eine Differenzierung in asymmetrische und symmetrische Konnektivität ist für rückgekoppelte Netzwerke zu beachten. Die symmetrischen Topologien minimieren die Energiefunktion, was auch als sogenannte Relaxation beschrieben wird. Im Gegensatz dazu spricht man während des Vorgangs der assoziativen Speicherung einer Sequenz von den asymmetrischen Rückkopplungen.

Abbildung in dieser Leseprobe nicht enthalten

Abb. 5: Winner-takes-all-Netze mit lateraler Inhibition in der Wettbewerbsschicht (Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution. Seite 9.)

Des Weiteren kann ein Schaltkreis im modularen Sinne aus den azyklischen und rückgekoppelten Bestandteilen bestehen.[16]

Die Funktion, die mithilfe eines neuronalen Netzes ermittelt wird, charakterisiert sich aus einer Eingabe, an welcher das Eingabeneuron lokalisiert ist. Innerhalb dieses Prozesses werden alle Neuronen, plus deren Ausgabewerte, mehrfach berechnet. Im Anschluss daran kann die Ausgabe der zugehörigen Ausgabeneuronen erhalten werden. Bei der Betrachtung von azyklischen Netzwerken ist feststellen, dass die Eingabeneuronen keinerlei Eingangskanten und auch die Ausgabeneuronen keinerlei Ausgangskanten aufweisen. Im Kontrast hierzu ist diese Gegebenheit bei den rückgekoppelten Topologien nicht festzustellen. Bei allen verbleibenden Neuronen ist von sogenannten verborgenen Neuronen zu sprechen.[17]

3.3 Das Neuron

Als grundlegender Bestandteil von neuronalen Netzen ist das Neuron selbst zu nennen. Die dazwischenliegenden Objekte, die eine verbindende Eigenschaft zweier Neuronen besitzen, stellen die Gewichte dar, wobei keine Verbindung existiert, wenn das Gewicht den Wert "0" trägt. Um die Ausgabe zu berechnen, ist es notwendig, alle Einflüsse der anderen Neuronen zu gewichten und aufzusummieren. Letztendlich wird dann auf diese Summe eine Ausgabefunktion in nichtlinearer Form angewendet.

Die Ausgabewerte der Neuronenwerte bei einem neuronalen Netz können zwischen "0" und "1" liegen. Hierbei kommen die lineare Schwellfunktion und die sigmoide Funktion als Ausgabefunktion in Frage. Bei Verwendung von binären Werten, lässt sich als Ausgabefunktion eine Stufenfunktion oder eine thermodynamische Verteilungsfunktion anwenden. Neben der klaren Abgrenzung von analoger oder binärer Arbeitsweise, existieren zudem auch Mischformen, wenn beispielsweise die Eingabe analog und die Ausgabe binär fungiert. Insgesamt ist erkennbar, dass die Bestandteile Gewichtsmatrix, Schwellenwerte und Ausgabefunktion ein neuronales Netzwerk komplett und vollständig definieren.[18]

3.4 Die Funktionsweise neuronaler Netze

Die Kernidee in der Erstellung neuronaler Netze steckt im Vorhaben, menschliche Intelligenz und Denkvorgänge auf der Arbeitsoberfläche eines Computers nachzubilden. Bis heute arbeiten zahlreiche Wissenschaftler, teils aus unterschiedlichen Bereichen, an der Gewinnung von Erkenntnissen bezüglich der Arbeits- und Funktionsweise des Gehirns. Dabei ist ein direkter Vergleich von neuronaler Netzen auf künstlicher Ebene mit dem menschlichen Gehirn zu ziehen. Letztendlich soll das menschliche Handeln mithilfe eines Modells auf biologischer Basis nacherschaffen werden. Um dieses Vorhaben in die Tat umsetzen zu können, müssen jedoch zuerst einige weitere kritische Punkte geklärt werden.[19]

Das menschliche Gehirn, vor allem die Hirnrinde (Neokortex), definiert sich als Ausgangspunkt jeglicher Aktionen und intelligenter Denkweisen. Es ist als Nervenzellengewebe bekannt. Dieses Gewebe besteht auf den Quadratmillimeter gesehen aus etwa 100.000 Nervenzellen, die sehr dicht miteinander verbunden sind. Genau darunter ist die biologische Basis von künstlichen neuronalen Netzen zu verstehen. Es lässt sich hierbei von sogenannten „Recheneinheiten“ reden.

Etwa 100 Milliarden dieser, sehr komplex miteinander verbundenen Neuronen, sind im menschlichen Gehirn zu finden. Die Forschungen der letzten Jahre und Jahrzehnte hat gezeigt, dass Gehirne eine parallele Struktur aufweisen, da ein einziges Neuron mit etwa 1.000 oder sogar 10.000 weiteren Neuronen verknüpft ist. Daraus resultierend beeindruckt es mit einer hohen Leistungsfähigkeit und einer enormen Schnelligkeit.

Im Allgemeinen besteht ein biologisches Neuron aus drei Bestandteilen, welche der Verarbeitung von Informationen dienen. Die erste Komponente ist der Dendritenbaum, welcher Informationen aufnehmen kann. Als Nächstes ist der Zellkörper (Soma) zu nennen. Dieser fungiert als verarbeitendes Element der Informationen. Als Letztes ist das Axon zu erwähnen, welches die vorher eingegangenen und verarbeiteten Informationen nun im letzten Schritt wieder aussendet.[20]

Abbildung in dieser Leseprobe nicht enthalten

Abb. 6: Aufbau eines biologischen Neurons (schematisch) (Vgl. Füser, Karten (2013): Neuronale Netze in der Finanzwirtschaft. Innovative Konzepte und Einsatzmöglichkeiten. Seite 12.)

Das Axon ist eine lange schmale Nervenfaser, welche sich wiederum in zahlreiche weitere Zweige teilt. Es ist in der Lage, die Signale eines Neurons an weitere umliegende Neuronen zu senden. Diese Weiterleitung erfolgt mithilfe von elektrischer Ladung. Dabei haben die Synapsen eine hohe Bedeutung, da sie den Wirkungsgrad der sogenannten Übergangsstellen ausdrücken. Im Genaueren handelt es sich um die Intensität eines Signals, welche ein Neuron auf ein anderes Neuron ausgibt. Außerdem ist eine Synapse als Bindeelement zweier Neuronen und deswegen auch als Schnittstelle zu sehen. Es kann allerdings passieren, dass mittels des Axons Impulse an nachfolgende Neuronen weitergesendet werden. Das geschieht, wenn die eingehenden Informationen, welche an den Synapsen gewichtet werden, einen bestimmten Schwellenwert übersteigen. Hier wird das Signal in ähnlicher Form weiterverarbeitet.

Somit ist unter einem Neuron ein komplexer Prozessor zu verstehen, welcher alle eingehenden Signale zum einen verarbeitet, diese wieder ausgibt und letztendlich an weitere benachbarte Zellen verteilt.[21]

Bezüglich der Funktionsarten ist am Neuroneneingang zwischen zwei Synapsen zu unterscheiden. Den erregenden (exzitatorischen) und den hemmenden (inhibitorischen) Synapsen. Die Synapsen sind also Träger von Informationen und fungieren als Schalter, um den Austausch unter den Neuronen zu ermöglichen. Ergänzend dazu besitzen sie auch eine hohe Wichtigkeit in punkto des Lernens, welches bei der Anpassung der eingehenden Informationen von Neuronen vonstattengeht. Dahinter verbergen sich sogenannte synaptische Übertragungsfaktoren. Der grundlegende Aspekt ist im biologischen Sinne als auch bei künstlichen neuronalen Netzen innerhalb der Ausprägungen der synaptischen Übertragungsfaktoren eines Neurons zu sehen, welche aus dem Lernvorgang resultieren.[22]

„Das Verhalten eines künstlichen Neurons hängt somit sowohl von Gewichten, den Synapsen, dem Lernmechanismus zur Anpassung der Synapsenstärken, als auch von deren Verarbeitungsfunktion ab. Die Funktionalität eines Neuronalen Netzes basiert folglich auf der Formulierung von Verarbeitungs- und Lernmechanismen für künstliche Neuronen, wobei deren geeigneter Zusammenschluß ein Neuronales Netz ausmacht.“[23]

Dadurch lässt sich feststellen, dass die Nacherschaffung des menschlichen Gehirns sowie das Nachvollziehen dessen Funktionsweise, die Hauptgedanken bei der Entwicklung neuronaler Netze sind. Das Hauptaugenmerk liegt dabei auf dem Zusammenarbeiten hochgradig untereinander vernetzter Nervenzellen. Diese neuronalen Netze verfügen über rechnerische Vorgehensweisen, welche dem Gehirn eigen sind. Sie sind jedoch nicht direkt als Modell eines menschlichen Gehirns zu sehen.[24]

3.5 Der Lernalgorithmus

Künstliche neuronale Netze durchlaufen insgesamt zwei Stufen. In der ersten davon, der Arbeitsphase, wird das Netz in die Lage versetzt, nach der Verwertung aller Eingabewerte, aussagekräftige Ausgabewerte zu senden. Während dieser Arbeitsschritte werden alle Werte des Modells beibehalten. In der Trainingsphase findet jedoch keine Ergebnisausgabe statt. Hier werden vielmehr Spezifikationen des Modells anhand diverser Regeln getroffen.

Der komplette Lernvorgang umfasst nach der Anpassung des Modells:

- Das Erstellen und Entfernen von Verknüpfungen

- Das Erstellen und Entfernen von Neuronen

- Die Veränderung der Gewichte

- Die Veränderung der Neuronenspezifikation (Aktivierungsfunktion)

Die am meisten angewendete Methode bezüglich des Lernens ist die Gewichtsänderung. Wird das Gewicht hierbei auf den Wert 0 gesetzt, kann dies auch mit dem Wegfall von Verbindungen gleichgesetzt werden. Genau dieses Thema wird im nachfolgenden Text näher erläutert.[25]

Das Ziel bei diesem Lernprozess der neuronalen Netze ist, dass die Ausgabewerte in Bezug auf die Sollwerte eine so klein wie mögliche Fehleranfälligkeit aufweisen. Die Ermittlung dieser Fehler erfolgt mittels Fehler- bzw. Zielfunktion. Da eine anderweitige Anpassung der Gewichte nur sehr kompliziert zu realisieren ist, kommt es zum Einsatz von numerischen Verfahren. Im Zusammenhang damit wird ein Näherungsverfahren angewandt. Grundlegend gesehen ist eine Differenzierung in überwachte und nicht überwachte Lernverfahren zu treffen. Welche der beiden Algorithmen nun angewendet wird, ermittelt sich durch die Wahl der Netzwerkbeschaffenheit.

Nach einem Blick in die neuere Literatur wird deutlich, dass über das unüberwachte Lernen relativ wenig verfasst wurde, vielmehr liegt der Hauptfokus auf dem Verfahren des überwachten Lernens. Eine Hauptschwäche des unüberwachten Lernens ist es, dass hierbei keine Möglichkeit existiert, um an Soll-Ausgabewerte zu gelangen, welche für die Fehlerfindung des Netzes notwendig sind. Es ist lediglich machbar, bestimmte Ähnlichkeiten innerhalb der Eingabemuster festzustellen. Als Beispiel für ein solches unüberwachtes Verfahren ist die Hebb’sche Lernregel zu nennen. Laut dieser Regel wird das Gewicht zwischen Neuronen erhöht, wenn die Neuronen außerdem hochgradig aktiv sind.[26]

[...]

[1] Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen. Seite 33.

[2] Vgl. Friedrich, Andreas (2004): Neuronale Netze: Theoretische Grundlagen und Anwendung in der Verkehrszeichenerkennung. Seite 1.

[3] Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen. Seite 33-34.

[4] Vgl. Ziegler, Wolfgang (2015): Neuronale Netze. Seite 1-2.

[5] Vgl. Scherer, Andreas (1997): Neuronale Netze: Grundlagen und Anwendungen. Seite 34.

[6] Vgl. Ertel, Wolfgang (2016): Grundkurs Künstliche Intelligenz. Eine praxisorientierte Einführung. Seite 1.

[7] Vgl. Ebd. Seite 1.

[8] Vgl. Ertel, Wolfgang (2016): Grundkurs Künstliche Intelligenz. Eine praxisorientierte Einführung. Seite 15-16.

[9] Vgl. Ebd. Seite 16-17.

[10] Vgl. Braun, Heinrich / Feulner, Johannes / Malaka, Rainer (1996): Praktikum Neuronale Netze. Seite 1.

[11] Vgl. May, Constantin (1996): PPS mit Neuronalen Netzen: Analyse unter Berücksichtigung der Besonderheiten der Verfahrensindustrie. Seite 74-75.

[12] Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution. Seite 7.

[13] Vgl. Braun, Heinrich (1997): Neuronale Netze. Optimierung durch Lernen und Evolution. Seite 7.

[14] Vgl. Ebd. Seite 8.

[15] Vgl. Ebd. Seite 8.

[16] Vgl. Ebd. Seite 9.

[17] Vgl. Ebd. Seite 10.

[18] Vgl. Braun, Heinrich / Feulner, Johannes / Malaka, Rainer (1996): Praktikum Neuronale Netze. Seite 1.

[19] Vgl. Füser, Karsten (2013): Neuronale Netze in der Finanzwirtschaft. Innovative Konzepte und Einsatzmöglichkeiten. Seite 11.

[20] Vgl. Ebd. Seite 12.

[21] Vgl. Ebd. Seite 13.

[22] Vgl. Ebd. Seite 14.

[23] Vgl. Ebd. Seite 14.

[24] Vgl. Ebd. Seite 14.

[25] Vgl. Rascher, Markus (2013): Künstliche neuronale Netze zur Risikomessung bei Aktien und Renten: Am Beispiel deutscher Lebensversicherungsunternehmen. Seite 44.

[26] Vgl. Ebd. Seite 45.

- Arbeit zitieren

- Eric Thomas (Autor:in), 2017, Software zur Simulation Neuronaler Netze. Eine Bewertung der Nutzerfreundlichkeit, München, GRIN Verlag, https://www.grin.com/document/378453

Kostenlos Autor werden

Kommentare